Profesores Temen Fin de las Tareas por Este Robot

N+

La inteligencia ChatGPT entrega respuestas que en ocasiones brillan por su precisión y claridad

¿ChatGPT terminará con las tareas? Profesores temen que sí. Foto: Pexels | Ilustrativa

COMPARTE:

La empresa OpenAI ha lanzado el robot conversacional ChatGPT. La fluidez de las respuestas que entrega este chatbot ha sorprendido a miles de usuarios de Internet. Curiosamente, uno de los primeros efectos que ha tenido esta inteligencia artificial es poner en riesgo las tareas como método tradicional de enseñanza en la escuelas.

Te recomendamos: Lensa AI, Qué Es y Cómo Funciona la App de Selfies Fantásticas

Cualquier persona puede conversar con ChatGPT a través de Internet de forma gratuita. No pocos internautas han quedado impresionados ante la calidad de las respuestas que ofrece este robot: es capaz de explicar conceptos científicos, recopilar datos históricos y resumir libros enteros con cierto grado de precisión.

Sus sorprendentes capacidades han llevado a no pocos profesores y académicos a preguntarse si este chatbot arruinará la enseñanza tradicional en los colegios. Una de las principales herramientas de aprendizaje con que cuentan los maestros modernos es la asignación de trabajo en casa, que puede incluir ensayos o resúmenes de lecturas.

ChatGPT puede cubrir con cierta holgura ambas tareas, aunque no está exenta de errores e imprecisiones. Si se le pregunta, por ejemplo, de qué trata Las batallas en el desierto de José Emilio Pacheco, un libro fundamental de la literatura mexicana, ChatGPT responde que se trata sobre “un niño llamado Jericó y su vida en una familia disfuncional en México”.

El problema es que el personaje no se llama Jericó, sino Carlos. Esta aplicación de inteligencia artificial tampoco logra responder con claridad cuál es la anécdota del libro.

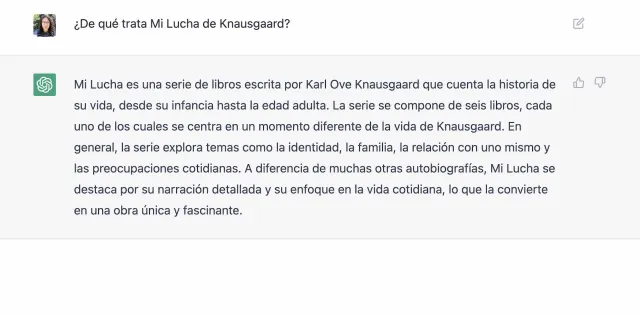

No obstante, cuando se le pregunta por el contenido de Mi lucha, serie de novelas escritas por el autor noruego Karl Ove Knausgaard, la situación cambia. ChatGPT entrega un resumen aceptable de la obra autobiográfica del autor noruego. En ese caso responde:

Mi Lucha es una serie de libros escrita por Karl Ove Knausgaard que cuenta la historia de su vida, desde su infancia hasta la edad adulta. La serie se compone de seis libros, cada uno de los cuales se centra en un momento diferente de la vida de Knausgaard

El diario inglés The Guardian reporta que varios académicos han comprobado que ChatGPT puede entregar trabajos que obtendrían la máxima calificación, si fuesen presentados por un estudiante universitario.

Estas capacidades ponen en riesgo la fiabilidad de las tareas escritas que los alumnos elaboran desde casa. Aunque de momento sería relativamente sencillo descubrir a un alumno que hace trampa con ChatGPT, el riesgo es que los alumnos confíen demasiado en resúmenes inexactos y datos históricos incorrectos, como los que llega a mostrar esta herramienta.

Al respecto, la especialista Lilian Edwards declaró a Nature que “la evaluación por medio de ensayos está muerta, de verdad”. La académica de la Universidad de Newcastle, en Reino Unido, afirma que la llegada de ChatGPT indicaría, cuando menos, el fin de las tareas escritas en la educación contemporánea.

El problema de fondo, según la especialista San Wachter, no es que los alumnos usen estas herramientas para escribir, sino para pensar.

“Hace algunos años los chatbots tenían el vocabulario de un diccionario y la memoria de un pez. Hoy son mucho mejores para reaccionar de forma coherente en función del historial de búsquedas y de respuestas. Hoy ya son más que simples peces”, declaró a AFP Sean McGregor, un investigador que compila incidentes relacionados con inteligencia artificial.

De momento, ChatGPT tiene una gran debilidad: puede fingir que piensa, pero no puede pensar realmente. Claude de Loupy, quien dirige Syllabs, una empresa de tecnología francesa dedicada a la generación automática de texto, señaló a AFP que estos programas “no tienen acceso al sentido” y no pueden justificar sus decisiones ni explicar los motivos detrás de sus respuestas.

Con información de AFP